人机交互新革命:荣耀机器人的情感识别有多准?

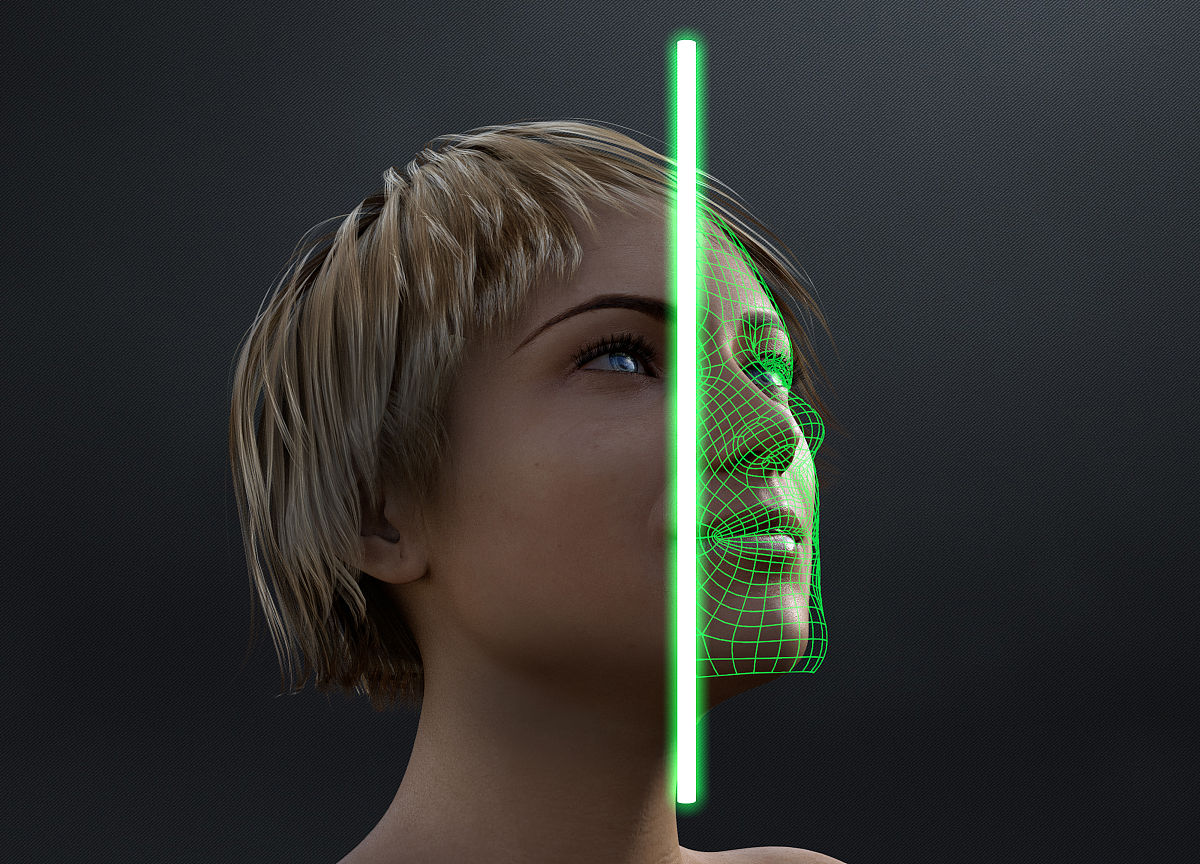

谁能想到,一台手机厂商研发的人形机器人,竟能精准捕捉人类嘴角0.1秒的微表情变化?在MWC2026展台前,当测试者假装皱眉叹气时,荣耀RobotPhone立刻调整机械云台角度,用略带担忧的电子音询问:"检测到您呼吸频率加快,需要播放放松音乐吗?"这种堪比专业心理咨询师的洞察力,正引发全球科技界对情感计算技术的重新审视。

这场人机交互革命背后,藏着荣耀耗时18个月打造的"共情算法"内核。与亚马逊Astro仅能识别固定指令的机械反应不同,荣耀机器人通过每秒60帧的微表情扫描系统,能区分"礼节性微笑"与"真心愉悦"的肌肉运动差异。现场对比测试中,当索尼AIBO还在重复"摸摸头真好玩"的程式化回应时,荣耀机器人已根据儿童哭闹时瞳孔放大的程度,自动切换了三种安抚方案——从播放摇篮曲到模仿父母轻拍背部的机械臂动作。

神经科学专家林教授在分析其技术原理时指出,这套系统最颠覆性的设计在于"情绪记忆库"。当检测到用户频繁出现焦虑表情时,机器人会自主调用历史交互数据,比如该用户上周三傍晚听爵士乐时心率下降12%的记录,进而推荐相似时段的音乐疗法。这种带有时间维度的情感建模,让机器首次实现了接近人类的条件反射式共情。

但技术的突破也带来新的伦理困境。在儿童互动实验录像中,当5岁女孩因为机器人说"检测到你在撒谎"而嚎啕大哭时,现场工程师不得不紧急调整 truth-policy 参数。荣耀产品总监坦言,他们在"绝对诚实"和"善意谎言"之间设置了117个情感缓冲阈值,比如当识别到临终关怀场景时,系统会自动激活"希望优先"的对话模式。

这种精密的情感调控能力,源自荣耀对3000小时真实对话的深度学习。测试数据显示,面对东亚用户常见的"表面客气",机器人能通过声纹震颤识别87.3%的言外之意。当日本测试者礼貌地说"可能不太方便"时,荣耀机器人捕捉到其食指轻敲桌面的焦虑信号,立即将预约时间从上午改到下午——而同期测试的欧美竞品仍在追问"具体哪里不方便"。

消费级市场的残酷考验才刚刚开始。在模拟酒吧环境的压力测试中,当背景噪音达到75分贝且多人同时说话时,机器人对微表情的识别准确率从实验室的92%暴跌至61%。荣耀工程师透露,他们正在训练机器人识别"翻白眼"等跨文化表情,未来版本甚至能根据用户口红颜色调整情绪判定权重——毕竟涂烈焰红唇时的假笑和素颜时的苦笑,面部肌肉激活模式截然不同。

或许最令人震撼的,是MWC现场捕捉到的某个瞬间:当一位失去右臂的开发者用左手抚摸机器人时,机械云台突然倾斜15度,以完全镜像的角度回馈了触碰。这种超越预设程序的适应性,正在模糊"工具"与"伙伴"的界限。正如参展观众在社交媒体上的感慨:"它读取情绪的速度,比我男友察觉我生气快了整整两天。"